برگرفته از Google Webmaster Help Forum

چگونه وبسایت خود را برای موتور جستجوی گوگل بهینه سازی کنیم ؟ (قسمت نهم)- استفاده موثر و صحیح از فایل های robots.txt

از robots.txt ها به طور موثر و صحیح استفاده کنید

“خزیدن در محتوا را در جایی که این کار توسط robots.txt ها لازم نیست، محدود کنید”

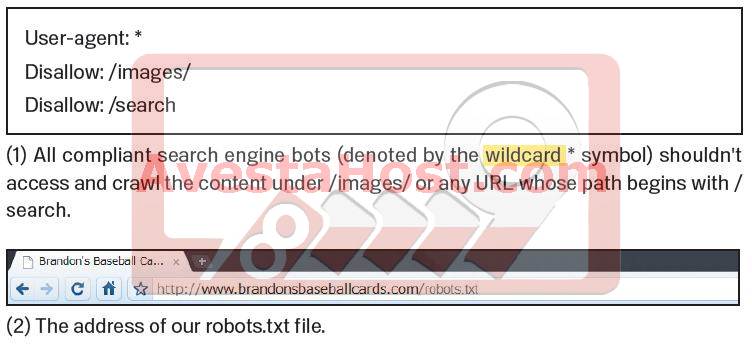

یک فایل “robots.txt” به موتورهای جستجو می گوید که آیا انها می توانند به بخش های سایت شما دسترسی پیدا کنند و در آن به جستجو بپردازند (۱). این فایل، که باید “robots.txt” نامیده شود، در دایرکتوری روت سایت شما قرار می گیرد (۲).

ممکن است شما تمایل نداشته باشید که برخی از صفحات سایتتان مورد جستجو قرار بگیرد زیرا تصور می کنید که این صفحات اگر در نتایج موتورهای جستجو ظاهر شوند برای کاربران مفید نیستند. اگر می خواهید از خزیدن موتورهای جستجو در صفحات سایت خود جلوگیری کنید ، Google Webmaster Tools یک robots.txt generator خوب دارد که به شما کمک می کند این فایل را ایجاد کنید. توجه کنید که اگر در سایت خود از subdomains ها استفاده می کنید و اگر می خواهید برخی صفحات در یک subdomain خاص مورد جستجو قرار نگیرد، شما باید یک فایل robots.txt جداگانه برای آن subdomain ایجاد کنید.

روش های زیادی وجود دارد که از ظاهر شدن محتوا در نتایج جستجو جلوگیری می کند مانند اضافه کردن “NOINDEX” به متا تگ robots شما، استفاده از .htaccess برای پسوردگذاری امن برای دایرکتوری ها و استفاده از Google Webmaster Tools برای حذف محتوایی که قبلا مورد جستجو قرار گرفته است. یکی از مهندسین شرکت گوگل ، Matt Cutts ، ویدئوی مفیدی در رابطه با “رعایت موارد لازم برای هر یک از روش های مسدود کردن URL ” تهیه کرده است.

“بهترین روش ها“

برای محتواهای حساس از روش های امن تر استفاده کنید

به هنگام استفاده از robots.txt برای مسدود کردن موارد حساس و محرمانه، شما نباید احساس راحتی کنید! یکی از دلایل این امر اینست که موتورهای جستجو باز هم قادرند به URL هایی که شما مسدود کرده اید مراجعه کنند (فقط URL را نشان می دهد و عنوان یا snippet را نشان نمی دهد)، چنانچه سایت های دیگر در اینترنت لینک هایی به URL های مربوطه داشته باشند (مانند referrer logs).

همچنین موتورهای جستجوی ناسازگار یا سرکش که Robots Exclusion Standard را به رسمیت نمی شناسند، از دستورالعمل های robots.txt شما پیروی نمی کنند. در نهایت یک کاربر کنجکاو به بررسی دایرکتوری ها و دایرکتوری های فرعی در فایل robots.txt شما می پردازد و محتوایی که شما نمی خواهید دیده شود را پیدا می کند. رمزگذاری محتوا یا محافظت از پسورد با .htaccess ، راه حل های جایگزین امن تری هستند.

نکته:

- اجازه ندهید صفحاتی که در نتایج جستجو شبیه هم هستند مورد جستجو قرار بگیرند.

– کاربران دوست ندارند در نتایج جستجو از یک صفحه دست بکشند و به صفحه ای بروند که ارزش قابل توجهی برای آنها ندارد.

-

اجازه ندهید URL هایی که در نتیجه سرویس های پروکسی ایجاد می شوند، مورد جستجو قرار گیرند.

تهیه و ترجمه توسط تیم آموزشی اوستا هاست